Survivorship Bias

Warum wir von 100-Jährigen nicht lernen können, wie man 100 Jahre alt wird.

Der Tages-Anzeiger hat unlängst ein interessantes Interview mit der Psychologieprofessorin Daniela Jopp veröffentlicht (Das Interview kam ursprünglich in der Welt am Sonntag.). Jopp forscht zu sogenannten Centenarians: Menschen, die 100 Jahre oder älter werden. Das Interview dreht sich um die Frage, warum Hundertjährige so alt werden. “Das weiss Daniela Jopp”.

Das ist natürlich eine sehr wichtige Fragestellung. Wenn Menschen möglichst gesund möglichst alt werden können, ist das moralisch positiv. Mehr lebenswerte Lebensjahre sind wünschenswert.

Im Interview nennt Jopp einige Eigenschaften der Centenarians, die zu ihrem hohen Alter beigetragen haben. Sie haben hohe Resilienz gegen Krisen und Rückschläge, sie sind optimistisch, sie verfolgen ihre Leidenschaften, sie hatten immer viel Bewegung. Das klingt alles gut. Das sind also Dinge, welche sich jüngere Menschen zu Herzen nehmen können, und dann werden sie auch 100 Jahre alt. Oder?

Nein, leider nicht. Alles, was Jopp beschreibt, trifft für sich genommen zu. Die Dinge, die sie bei Hundertjährigen beobachtet, sind rein deskriptiv durchaus korrekte Beobachtungen. Aber daraus lässt sich nicht kausal schliessen, warum Hundertjährige so alt geworden sind. Warum? Weil man gleichzeitig auch prüfen müsste, was für Eigenschaften Menschen haben, die nicht 100 Jahre alt werden. Wenn man das nicht tut, begeht man den Denkfehler des Survivorship Bias.

Der Survivorship Bias

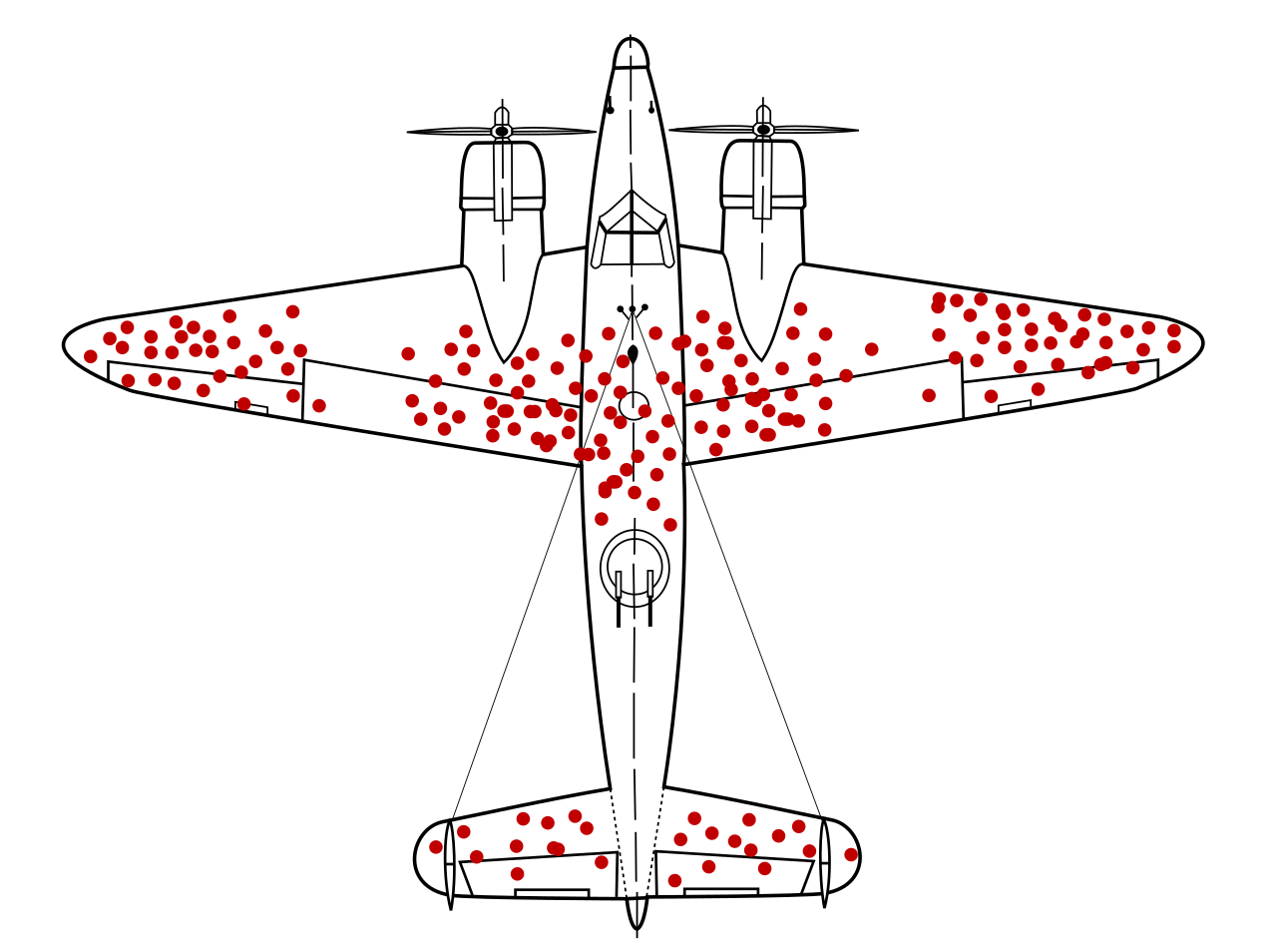

Im Zweiten Weltkrieg wurden zum ersten Mal Flugzeuge in grossem Umfang eingesetzt. Alle Kriegsparteien wollten, dass so wenige Flugzeuge wie möglich abgeschossen werden. Das Problem war, dass man die Panzerung von Flugzeugen nicht unendlich erhöhen kann, weil sie irgendwann weniger gut oder gar nicht mehr fliegen.

Die Lösung für dieses Problem scheint offensichtlich: Man schaut sich an, wo Flugzeuge beschossen wurden, und verstärkt die Flugzeuge an den Stellen mit Einschusslöchern. Das wirkt logisch. Ist es das auch?

Nicht ganz. Das wusste zum Beispiel der Statistiker Abraham Wald, der im Zweiten Weltkrieg für die US-Armee als Berater tätig war. Er untersuchte die Überlebensraten von Flugzeugen und argumentierte, dass man auch auf die Flugzeuge, die es nicht zurückschaffen, achten muss. Er kam zum Schluss: Flugzeuge müssen dort verstärkt werden, wo die überlebenden Flugzeuge relativ wenige Einschusslöcher haben.

Das ist auf den ersten Blick kontraintuitiv. Man muss Flugzeuge doch dort verstärken, wo sie beschossen werden? Grundsätzlich ja. Das Problem bei der Analyse der Flugzeuge ist aber, dass man zunächst nur einen Teil der Flugzeuge sieht — nämlich die Flugzeuge, die zurückkehren. Die Flugzeuge, die abgeschossen wurden, fallen aus der Stichprobe heraus. Sie haben den Filter der Datenselektion (in diesem Fall das wortwörtliche Überleben) nicht überstanden.

Das Problem mit dieser unvollständigen Stichprobe ist, dass die Flugzeuge, die abgeschossen wurden, vielleicht oder sogar wahrscheinlich ein anderes Muster der Einschusslöcher aufweisen. Warum? Weil die Flugzeuge mit den Einschusslöchern, die man beobachten kann, eben überlebt haben. Wenn die Flugzeuge, die abgeschossen wurden, die gleichen Muster von Einschusslöchern hätten, hätten sie auch überlebt. Folglich ist die Wahrscheinlichkeit hoch, dass die Flugzeuge, die nicht überlebt haben, an anderen Orten beschossen wurden.

Dieses berühmte Beispiel für Survivorship Bias kann auch als eine Form des Collider Bias verstanden werden. Wenn man nur überlebende Flugzeuge betrachtet, konditioniert man auf den Faktor Überleben — und der wird von Einschüssen an verschiedenen Stellen unabhängig voneinander beeinflusst. Dadurch entsteht eine künstliche Korrelation zwischen den Einschussstellen, die in der Gesamtpopulation nicht existiert.

Story schlägt Statistik

Der Survivorship Bias ist ein weit verbreiteter Denkfehler. Auch sehr kluge Menschen wie die Psychologieprofessorin und der Journalist im Interview machen ihn. Der Grund dafür ist einfach: Story schlägt Statistik.

Wir Menschen sind dafür gemacht, die Welt über einfache, kausal eindeutige Geschichten zu verstehen. Darum tritt der Survivorship Bias in vielen Domänen auf. Über ein Beispiel habe ich vor einigen Monaten geschrieben. SRF machte einen Dokumentarfilm über Menschen, die schwere Krankheit überlebt haben. Diese Fälle wurden als “Wunderheilungen” beschrieben, und die Filmemacher versuchten, herauszufinden, was kausal zu diesen Wunderheilungen geführt hat.

Was die Filmemacher nicht gemacht haben: Menschen anschauen, die ähnliche Krankheiten nicht überlebt haben. Hätten sie es getan, wäre klar, dass diese Menschen auch zu Gott gebetet und Heilkräuter konsumiert haben. Die vermeintlichen kausalen Gründe für die “Wunderheilungen” würden sich im Nu als Illusion entpuppen, wenn man den Survivorship Bias versteht.

Beim Survivorship Bias geht es nicht nur um wortwörtliches Überleben. Story schlägt Statistik ganz allgemein, wenn ein Filter überwunden wurde. Die erfolgreichen Fälle sind immer interessanter. Du willst reich werden? Schau dir an, was Mark Zuckerberg, Bill Gates und Elon Musk gemacht haben! Du willst die grosse Liebe finden? Schau dir an, was Menschen, die die grosse Liebe gefunden haben, gemacht haben! Du willst erfolgreicher Autor werden? Schau dir an, was Agatha Christie, J.K. Rowling und Stephen King gemacht haben!

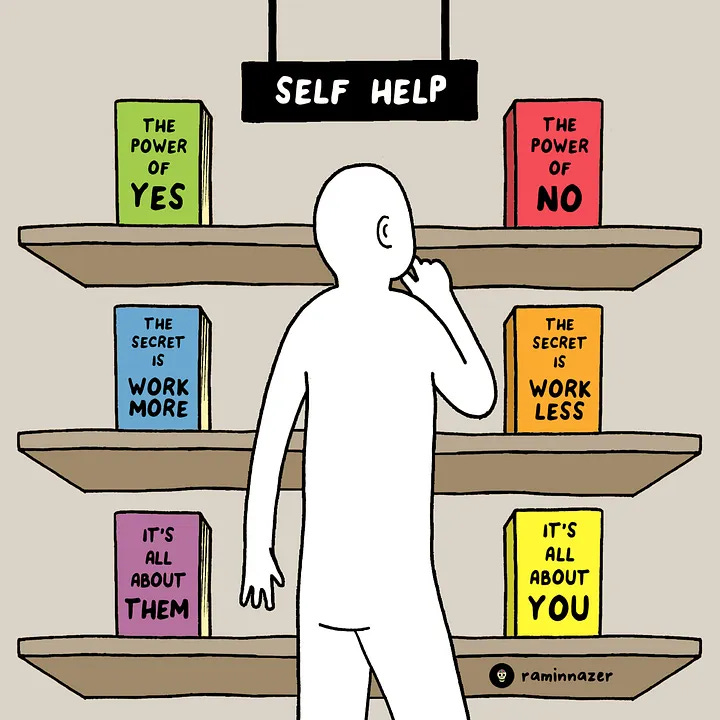

Survivorship Bias ist ein omnipräsenter Denkfehler. Es gibt nahezu endlos viele Ratgeber mit “Best Practice”-Anleitungen, in denen man von den Besten lernen kann, wie sie es geschafft haben. Ein Grossteil der Selbsthilfeindustrie basiert auf dem Survivorship Bias. Man findet Einzelfälle und spinnt daraus spannende Geschichten. Darum gibt es in der Selbsthilfe-Abteilung des Buchladens auch alle möglichen Tipps, die sich oft diametral widersprechen.

Der grösste Denkfehler überhaupt

Ich würde die Geschichte gerne hier abschliessen. Survivorship Bias ist ein lustiger Denkfehler, der dazu führt, dass Menschen manchmal Dinge glauben, die nicht funktionieren. Die Geschichte geht aber leider noch ein wenig weiter. Der Survivorship Bias ist in einem spezifischen Kontext nämlich besonders wichtig und besonders verheerend: Bei der Frage, wie lange es die Menschheit noch gibt.

Es gibt auf der Welt immer wieder grosse Krisen und Katastrophen, das ist vollkommen klar. Aber bisher ging es ja immer halbwegs gut aus — schliesslich sind wir noch da. Vielleicht kam es sogar mehr als halbwegs gut. Autoren wie Steven Pinker (“Enlightenment Now”) oder Hans Rosling (“Factfulness”) erklären in Bestseller-Büchern, dass die Welt trotz aller Probleme immer besser wurde. Und dass wir darum nicht so pessimistisch sein sollen.

Das stimmt für sich genommen, die Welt ist heute materiell besser als früher. Wenn ich die Wahl hätte, würde ich lieber im Jahr 2026 als im Jahr 1926 leben. Es gab recht offensichtlich sehr viel technologischen und moralischen Fortschritt in dieser Zeit. Aber die Intuition, dass sich daraus ein Trend hin zu Fortschritt oder nur schon zum Überleben der Menschheit ableiten lässt, ist gravierend falsch.

Bei der Frage, wie eine technologisch fortgeschrittene Zivilisation überleben kann, sind wir gleichzeitig sowohl Beobachter als auch Selektionskriterium. Wir nehmen systemische Risiken durch die verzerrte Brille wahr, dass wir systemische Risiken bisher überstanden haben. Das verleitet uns dazu, systemische Risiken zu unterschätzen oder sie gänzlich zu übersehen. Nach dem Motto: Es kommt schon gut, denn es kam ja bisher immer gut. Menschen haben die schlechte Angewohnheit, Risiken erst dann zu verstehen, wenn etwas Schlimmes passiert ist. Als Reaktion darauf kann man dann versuchen, solche schlimmen Ereignisse in Zukunft zu verhindern. Das ist für sich genommen eine nützliche Strategie, aber sie funktioniert bei systemischen Risiken nicht. Moderne technologiebedingte systemische Risiken sind so gross, dass ein einziger negativer Outcome so katastrophal sein kann, dass die menschliche Zivilisation kollabiert oder dass die Menschheit sogar unumkehrbar ausgelöscht wird. Mit anderen Worten: Wenn das schlimme Ereignis eintritt, wird es keine Möglichkeit mehr geben, auf das schlimme Ereignis zu reagieren. Es ist vorbei.

Diese Form des Survivorship Bias, bei dem wir sowohl Beobachter als auch Selektionskriterium sind, wird manchmal als anthropischer Bias beschrieben. Der anthropische Bias führt zu mindestens zwei Irrtümern. Erstens gehen auch schlaue Leute wie Steven Pinker davon aus, dass unser vergangenes Überleben ein Indikator dafür ist, dass wir aktiv etwas richtig gemacht haben. Das trifft bestenfalls nur teilweise zu. Es gibt systemische Risiken, die wir in der Vergangenheit aktiv abgebaut haben. Das Ozonloch ist das vielleicht berühmteste Beispiel. Aber viele systemische Risiken haben wir nicht abgebaut. Wir hatten einfach Glück. Wir haben zum Beispiel das Risiko von Atomkrieg nie abgebaut. Wir hatten einfach Glück, dass es bisher nicht zu einem Atomkrieg gekommen ist. Ein Risiko eingehen und es überstehen, ist die Definition von Glück. Glück hält nicht ewig.

Zweitens lenkt der anthropische Bias vom Umstand ab, dass sich die Risikolandschaft verändert. Multiplikative fat-tailed Risiken, die eine systemische Bedrohung darstellen, werden grösser und häufiger. Nur einige Beispiele: Künstliche Intelligenz, Klimawandel, Biotechnologie, resistente Keime, natürliche Pandemien oder auch Atombomben. Um den Vergleich oben mit 1926 wieder aufzugreifen: Seit 1926 haben technologischer und moralischer Fortschritt das Leben des Durchschnittsmenschen drastisch verbessert. Gleichzeitig ist die Wahrscheinlichkeit, dass die Menschheit als Ganze ausgelöscht wird, seit 1926 um Grössenordnungen gewachsen.

Damit will ich nicht sagen, dass die Menschheit dem Untergang geweiht ist. Das wäre Defätismus. Rein analytisch gilt: Alle Probleme, die Menschen verursachen, können Menschen grundsätzlich auch lösen. Nur ist es ausgesprochen schwierig. Der Erhalt der menschlichen Zivilisation ist ein Kampf gegen Entropie. Ein Sieg über Entropie (oder zumindest ein längeres Hinauszögern) ist nicht unmöglich, aber es ist die grösste Herausforderung, die es gibt. Wenn wir uns durch den Survivorship bzw. den anthropischen Bias in ein wohliges Gefühl von “es kommt schon gut” einlullen lassen, laufen wir blind ins Messer des Kollapses.

Langer Rede kurzer Sinn: Wir können von 100-Jährigen nicht lernen, wie man 100 Jahre alt wird. Wir können von einer Zivilisation, die bisher überlebt hat, nicht lernen, wie man überlebt. Der Survivorship Bias ist ein kleiner Denkfehler mit maximal grossen Konsequenzen.